ReinforceOS

让工业强化学习 从实验走向生产闭环

工业强化学习平台

ReinforceOS 面向复杂工业过程的自主决策与优化控制,负责把数据接入、任务编排、环境设计、策略训练、在线评估与部署协同收敛到一个平台里。 它不是单点算法工具,而是一套可以承接真实工业闭环落地的平台底座。

任务中心

训练 / 评估 / 发布

环境设计

拖拽编排 + 奖励函数

运行协同

平台侧统一留痕

Why ReinforceOS

为什么选择 ReinforceOS

借鉴你给的 `TSDB` 与 `IDMP` 页面写法,这里不再只强调“算法很强”,而是把平台闭环说清楚:ReinforceOS 的价值在于把训练、验证、部署与现场协同真正做成一体化。

把强化学习真正做成工业平台

不是单个算法脚本或研究框架,而是围绕工业场景做成可协作、可交付、可运维的平台化产品。

从数据接入到策略发布一体化

把数据、任务、训练、评估和部署协同放在同一工作流里,减少跨工具切换与交付断点。

兼顾学习能力与生产稳定性

融合 APC、人类先验和安全规则,在追求优化收益的同时保障现场稳定与质量边界。

适合真实工业项目长期迭代

平台沉淀版本、规则、日志与效果反馈,让模型和策略不再是一锤子买卖,而是持续演进资产。

Core Modules

平台核心能力

参考 `IDMP` 的“能力模块展开”写法,ReinforceOS 的重点被压缩成四个核心模块:算法引擎、任务环境编排、安全稳定机制和策略发布协同。

RL Engine

自研算法能力

自研强化学习算法引擎

支持高维状态动作空间、连续控制与离散决策等工业常见问题形态,围绕真实工况优化而非实验室理想数据构建。

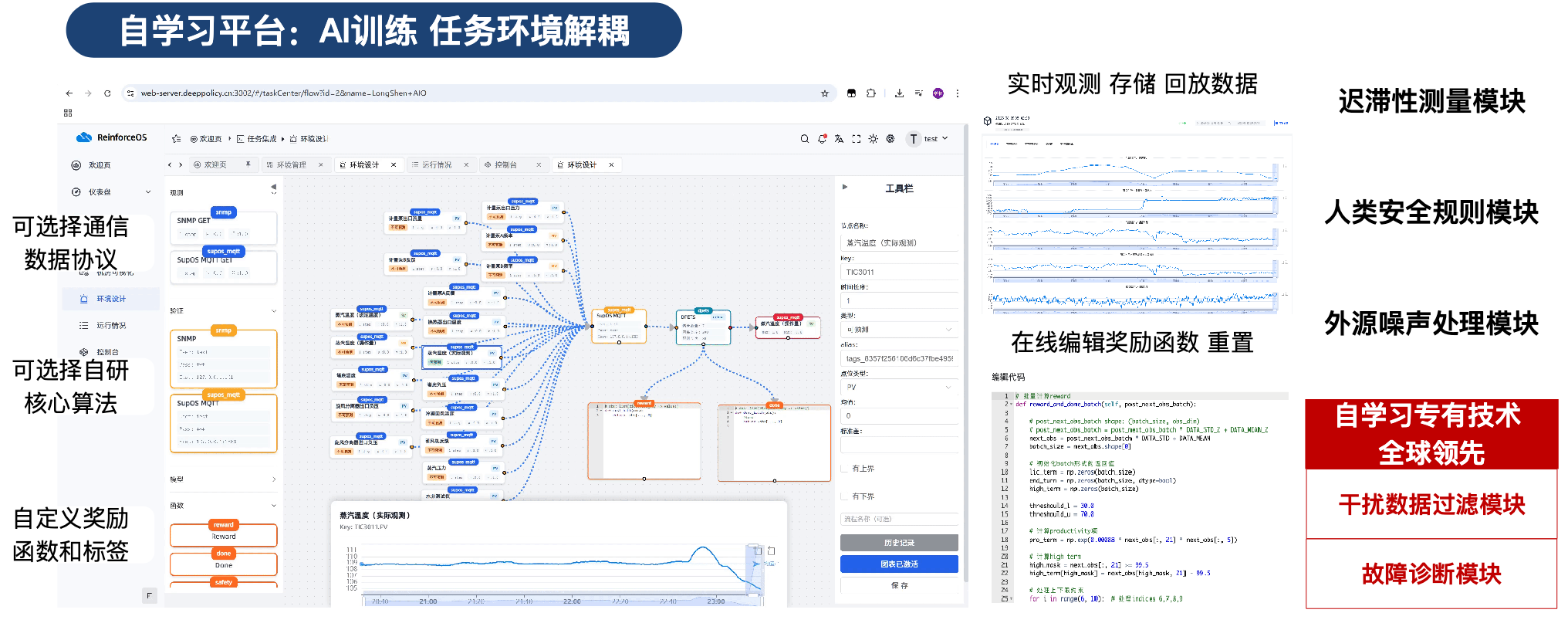

Task Design

环境设计与任务解耦

任务环境与奖励编排

训练对象、状态、动作、奖励和安全约束以平台化方式配置,降低把工业经验转成学习任务的门槛。

Stability Guard

安全规则与边界管理

安全稳定保障机制

将人类先验、稳定性约束、边界规则和异常处理机制前置到训练与验证流程中,减少策略上线风险。

Release Loop

验证到部署联动

策略发布与持续迭代

训练好的策略可进入验证、灰度和部署流程,并与 ReinforceLab、ReinforceBox 协同形成完整闭环。

Workflow & Ecosystem

从学习到部署的完整闭环

`IDMP` 页面有一个很值得借鉴的点:它强调的不是单个功能,而是“从数据到洞察的一体化路径”。ReinforceOS 对应的是从数据接入到策略部署的一体化闭环。

End-to-End Loop

典型业务路径

数据接入与特征整理

对接现场 DCS、PLC 或工业网关,形成训练与分析所需的数据视图。

任务与环境设计

定义状态、动作、奖励函数、安全边界和工况标签,完成训练任务抽象。

训练与在线评估

执行策略学习与效果评估,比较收益、稳定性、质量和能耗等关键指标。

验证、发布与终端部署

通过 ReinforceLab 完成验证后,交由 ReinforceBox 执行现场闭环控制。

协议与接入

部署形态

平台协同

Operations & Stability

不只是训练平台,也是运行协同底座

工业强化学习平台真正难的地方,不在把算法跑出来,而在让控制工程师、工艺工程师和运维团队一起长期使用。ReinforceOS 在这一层做了大量平台化工作。

Platform Assurance

从任务编排、版本演进到异常回溯,都围绕生产可用性设计。

平台将实验流程、策略版本、安全规则、运行记录与效果反馈组织在同一条链路上,降低跨团队协作时的信息断层。

任务编排

结构化管理

版本演进

可追溯 / 可回退

规则约束

训练与上线双重保护

结果回流

持续优化闭环

统一任务中心

训练、评估、版本和发布状态可在同一平台中跟踪,方便多角色协同。

效果量化对比

围绕收益、能耗、稳定性和质量指标量化策略效果,辅助决策是否推进上线。

安全规则前置

把边界限制、工艺先验和异常规则纳入平台流程,而不是留到上线后补救。

适配复杂工业工况

面向流程工业、公辅系统和群控场景,支持持续变化工况下的策略演进。

Use Cases

适用场景

ReinforceOS 适合那些已有现场数据、有优化目标、且希望把控制迭代沉淀为持续机制的工业场景。

流程工业优化控制

适用于蒸馏、燃烧、换热、公辅和多变量耦合控制等复杂过程优化场景。

计算中心群控优化

面向冷站、供配电和多设备联动场景,进行群控策略训练与协同调度优化。

需要持续迭代的策略项目

适合需要长期积累经验、持续优化策略效果,而不是一次性交付模型的项目。

已有数据基础的工业现场

只要现场已具备基础数据接入和优化目标,就可以逐步构建学习闭环与部署路径。